DistilQwen2.5-R1发布:知识蒸馏助推小模型深度思考

DistilQwen2.5-R1发布:知识蒸馏助推小模型深度思考 作者:蔡文睿(清素)、汪诚愚(熊兮)、严俊冰(玖烛)、黄俊(临在) 引言 随着 DeepSeek-R1 和 QwQ-32B 等面向深度推理的大语言模型的开源,“大模型+慢思考...

DistilQwen2.5-R1发布:知识蒸馏助推小模型深度思考 作者:蔡文睿(清素)、汪诚愚(熊兮)、严俊冰(玖烛)、黄俊(临在) 引言 随着 DeepSeek-R1 和 QwQ-32B 等面向深度推理的大语言模型的开源,“大模型+慢思考...

以前,不少商家对AI产品的真实态度是:AI技术“一眼假”! 这也揭开了当前行业AI应用的两个致命伤:其一,AI产出的效果未达预期;其二,AI的全场景应用并没实现。 AI正在全面“接管”电商经营么? 在AWE2025展的天猫家享生活行业展厅,...

2025年3月19日,东莞市人工智能大模型中心开服活动在迎宾馆成功举办。会上,工业和信息化部电子第五研究所副所长、数字化工业软件联盟理事长王蕴辉,东莞市工业和信息化局总经济师梁杨阳,以及东莞市工业和信息化局四级调研员黄碧琴共同出席第四届工业...

AI赋能产业新篇 | 中旭新能源召开2025年度首次AI加速产业智能化发展会议。 在当今科技迅猛发展的浪潮中,人工智能(AI)已成为推动各行业变革与升级的核心驱动力。中旭新能源于 2025年3月10日 - 12日成功举办了 “AI 加速产业...

关于印发《人工智能生成合成内容标识办法》的通知 国信办通字〔2025〕2号 各省、自治区、直辖市互联网信息办公室、通信管理局、公安厅(局)、广播电视局,新疆生产建设兵团互联网信息办公室、工业和信息化局、公安局、文化体育广电和旅游局: 为了促...

Spectrum仪器推出七款新型数字化仪,采样率10 GS/s,带宽4.7 GHz 中国北京,2025年3月12日讯 — Spectrum 仪器公司今日宣布推出七款新型数字化仪。该系列产品能够在GHz(千兆赫)范围内将信号的自...

随着数据要素市场化进程加速,如何在保障隐私安全的前提下充分释放数据价值,并基于当下大热的开源模型DeepSeek实现智能化转型,成为数字经济高质量发展的核心命题。 近日,优刻得数据安全流通平台“安全屋”已完成与DeepSeek全系列模型适配...

AI(人工智能)有多火?大家都有切身感受。 今年两会,全国人大首场新闻发布会上,AI也是热点话题之一:发言人娄勤俭频频为深度求索(DeepSeek)等中国AI企业点赞;会后,有记者追问:“有没有用过DeepSeek?”娄勤俭笑答:我学的专业...

3月3日,第五届Light创造营在厦门正式拉开帷幕。本届Light号召高校学子利用AI技术打造多元技术公益解决方案,共同应对社会公共议题,持续释放技术公益的内在价值。 据悉,本届Light在公益议题设置上更为开放,倡导满足联合国可持续发展目...

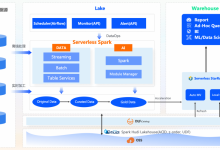

作者:美的楼宇科技事业部 先行研究中心智能技术部 美的楼宇科技 IoT 数据平台建设背景 美的楼宇科技事业部(以下简称楼宇科技)是美的集团旗下五大板块之一,产品覆盖多联机组、大型冷水机组、单元机、机房空调、扶梯、直梯、货梯以及楼宇自控软件和...